◎ 阿尔特曼、黄仁勋在不同场合表示,AGI或在五年内实现。

每经记者|李孟林 每经编辑|兰素英

“五年内,AGI很可能就会到来。”这不是科幻小说的情节,而是业界大佬的预言。

近日,随着Anthropic最新一代大模型Claude 3被曝表现出“自我意识”,以及马斯克正式起诉OpenAI及其首席执行官山姆•阿尔特曼,AGI(通用人工智能)再次成为AI届热议的话题。在对OpenAI的起诉书中,马斯克称OpenAI的GPT-4系统已经实现了AGI,不过OpenAI直接予以了否认。

这一系列事件让外界产生了一种错觉:AGI似乎真的不远了。阿尔特曼和英伟达CEO黄仁勋也相继表示,AGI可能在5年内实现。

然而,在沸沸扬扬的议论中,何谓AGI仍然是一个莫衷一是的概念。作为DeepMind的首席AGI科学家,Shane Legg曾是首批将这一概念引入计算机科学界的人之一。近期,他与同事联合发表了一篇论文,从六个方面定义了AGI,并划分了六个等级,为公众厘清AGI提供了参考。

由OpenAI前员工创建、获亚马逊大力支持的初创企业Anthropic最近推出了最新一代的大模型Claude 3.0,在许多关键指标与OpenAI最新的GPT-4打平甚至超越后者。

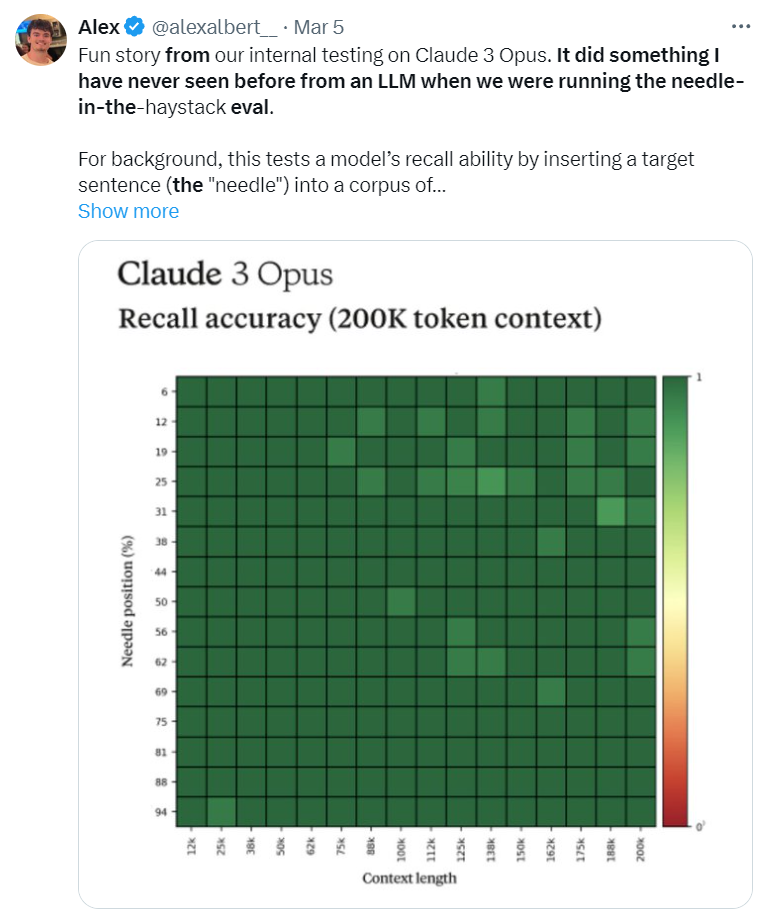

更有趣的是,该公司的员工Alex Albert在X平台(原推特)上表示,该系列模型的最强版本Claude 3 Opus在测试过程中,识别到人类在对其进行测试,展现出“自我意识”的迹象。

具体而言,测试人员在一大堆话题中插入了一个完全不相关的披萨配料问题,Claude 3 Opus表示:“我怀疑这个披萨配料‘事实’插入进来是一个玩笑,或者测试我是否在集中注意力,因为它跟其他问题完全不相匹配。”不少AI研究人员表示,这个模型展现出了“对思考进行思考”的元认知能力,自我意识进入到了一个新水平,似乎是朝向更高级的AGI迈了一步。

在此之前,OpenAI推出了“王炸级”文本生视频模型Sora,并将其定义为可以生成视频的世界模型(World Simulators),并认为这是打造通用世界模型的潜在方法之一。图灵奖得主、Meta的首席AI科学家杨力昆(Yann LeCun)一直认为,要实现AI的智能突破,需要一个能理解周遭世界的世界模型,才能最终通往AGI,而这也正是当前的大语言模型所缺乏的。

除开技术方面的进步,近期马斯克对OpenAI的起诉也将焦点之一对准了AGI。马斯克在起诉书中表示,GPT-4已经可以被当作早期的AGI,但是其内部细节只有OpenAI和微软才知道。这一说法是基于微软自己的评估。2023年3月,微软研究员在一份预印本论文中表示,GPT-4在很多能力上与人类持平或更强,已经有了AGI的“火花”。

所有这些让外界对AGI有了更强的期待,难道AGI真的离走进现实不远了?对此,部分业界大佬似乎有着乐观的预期。

OpenAI CEO阿尔特曼在电子书《我们的AI旅途》中的采访中提到,AGI可能在五年内实现。“5年左右,也许会稍长一些。没有人能说出一个确切的时间,也没有人知道它对社会的影响到底是什么。”阿尔特曼表示。“当AI能够独立完成创新的科学突破时,它就能被称为AGI了。”

与阿尔特曼不谋而合的还有英伟达的CEO黄仁勋。他在近期的一个论坛上表示,如果把AGI标准定为通过人类创制的各种测试的话,那么不出5年,AI就可以通过任何人类测试。当前的AI可以通过律师考试,但对胃肠病学等专业医疗测试仍然表现不佳。

但在乐观的氛围之外,也有人在泼冷水。纽约大学教授Gary Marcus就表示,依靠不断提高大模型的数据量并非解决AI现存问题的方法,芯片领域的摩尔定律不一定会在AI领域复现,大模型并非通往AGI的答案,AI需要的是范式转换。杨力昆同样认为,要实现人类水平的AI,当前的大语言模型是走了岔路,因为其实质是预测下一个单词,而无法谋划和推理。

1965年,AI研究先驱Herbert Simon曾乐观地预测,20年之内机器就可以完成人类的任何工作。很显然,现实离Simon的预测相差甚远。

AGI到底是什么?

正如许多前沿科学的关键概念一样,AGI的标准可谓众说纷纭,且其内涵一直在随着研究的进展不断变化。但有一点可以肯定的是,正如其名字“通用人工智能”所示,AGI一定是相对只能完成某种特定任务如下围棋或者翻译的“狭义”AI而言的。

在AGI概念之前,学术界对达到人类水平或以上的讨论集中在哲学界,如著名的“图灵测试”或哲学家约翰•赛尔提出的“强人工智能”等概念。1997年,北卡罗莱纳大学的物理学家Mark Gubrud首次提出了AGI这个概念。在他的定义中,AGI指的是在复杂程度和速度上可以和人脑媲美的AI系统,可以获取一般性知识,并以其为基础进行操作和推理,可以在任何工业或军事活动中发挥人类智力的作用。

OpenAI在其组织章程中,将AGI定义为“可以在大多数经济上有价值的工作中超越人类的高级自动系统”。谷歌研究院副总裁Blaise Agüera y Arcas则认为,AGI的关键指标在于“通用性”,既然当前的大模型已经能够讨论大多数问题,处理多种模态的信息输入输出,这就是已经是AGI了。

“如果你邀请100个AI专家来定义AGI,你可能会得到100个相互关联但又不同的定义。”2023年11月,知名AI公司DeepMind联合创始人、首席AGI科学家的Shane Legg及公司研究人员在一篇论文中表示。2002年,Legg便开始在计算机界普及AGI概念,按照他当时的定义,AGI是指在认知任务上能取得类人表现的机器智能。

而在最新的这篇论文中,Legg及其同事试图建立一个评估AGI的概念框架,是当前AI界对于AGI问题最深入的探讨之一。他们梳理了现在的AGI定义,并从中提取了6个AGI应该满足的原则,然后以类似自动驾驶分级的方式,给AGI的性能划分了五个阶段。

然而,这篇论文并没有给出AGI的定义,只是给出了定义AGI的六项原则。具体而言:

1、注重能力,而非过程:即只考虑AI系统完成任务的能力,而不考虑系统的推理过程是否像人脑一样思考,也不讨论系统是有“意识”和“感知能力”。

2、注重通用性与性能:既要考虑AI系统的通用性(宽度),也要考虑其性能水平(深度)。Blaise Agüera y Arcas的标准就过度关注通用性,而忽视了性能标准。

3、注重认知与元认知任务:即聚焦在非实体的“认知”活动上,暂不考虑AI系统“具身化”到机器人系统,从而在现实世界操作的能力。

4、专注于潜力而不是实际应用:即AI系统需要具备某种能力的潜能即可,不需要在现实世界中达到此种效果,因为后者涉及社会、法律、伦理等多种因素制约。

5、重视实际适用性:指评价AGI的标准应该是完成现实世界中人类觉得有价值的任务。

6、关注实现AGI的路径,而非单一终点:即将AGI的能力分为多个层级,而非单个的门槛标准,从而能容纳多种AGI的定义方式。

按照最后一个原则,该论文也将AGI分为了L0到L5六个等级,分别为:无AI,初现,合格,专家,大师和超人类。论文认为,2023年推出的ChatGPT、谷歌Bard、Meta的Llama 2,即当前主要的大模型,还处在L1阶段,也就是和未经训练的普通人差不多或稍好一点。后四个等级的AGI都还没有出现。接下来的L2到L5级别,分别对应超越50%、90%、99%和100%的有技巧成年人。

封面图片来源:新华社记者 金立旺 摄

1本文为《每日经济新闻》原创作品。

2 未经《每日经济新闻》授权,不得以任何方式加以使用,包括但不限于转载、摘编、复制或建立镜像等,违者必究。